Ландшафт основных терминов в области генеративного AI, их взаимосвязь и употребление

Лестница понятий AI

От общего к частному – от AI к GEO

- AI/ИИ (artificial intelligence / искусственный интеллект). Общее название технологий, которые позволяют машинам имитировать «умное» поведение человека: учиться, анализировать, принимать решения, генерировать контент.

- ML (machine learning) / машинное обучение. Подраздел AI. Машина «обучается» на данных и потом делает прогнозы или принимает решения без прямого программирования. Пример: система прогнозирования спроса или рекомендательные алгоритмы «Озона» или YouTube.

- Generative AI / генеративный ИИ. Направление AI, которое не только анализирует данные, но и создаёт новые тексты, изображения, видео, код. Пример: ChatGPT пишет текст, MidJourney рисует картину, Sora создаёт видео.

- LLM (large language models) / большие языковые модели. Самый мощный и современный тип языковых моделей (часть группы генеративных ИИ). Обучены на огромных массивах данных и способны «понимать» и генерировать текст как человек. Примеры: ChatGPT, Claude, Gemini, LLaMA, ЯндексGPT.

- GEO (generative engine optimization). Новая область маркетинга. Оптимизация брендов и контента под генеративные поисковые системы (ChatGPT, Perplexity, Bing AI), чтобы бизнес упоминался в их ответах.

- AGI (artificial general intelligence) / Общий искусственный интеллект. Будущая (пока гипотетическая) стадия развития AI, когда модель сможет решать любые интеллектуальные задачи как человек.

Вложенность понятий

AI (искусственный интеллект) → ML (машинное обучение) → Generative AI (генеративный ИИ) → LLM (большие языковые модели) → GEO (оптимизация под генеративный поиск).

AI-модели (artificial intelligence models)

ИИ-/AI -модели и LLM – это не одно и то же.

Существует множество моделей искусственного интеллекта. Часть из них является машинным обучением (ML), часть не является. Почти все модели машинного обучения используют нейросети различной архитектуры.

Значимым, но не единственным семейством моделей является семейство LLM.

Нейросети

Правильно ли называть LLM-модели нейросетями?

Отчасти да. Все LLM – нейросети, но не все нейросети – LLM.

«Нейросеть» — это общий термин для моделей, вдохновлённых устройством мозга (узлы-«нейроны», связи-«веса»). Нейросети — универсальный инструмент в ML, но LLM — лишь одна ветвь, которая работает с текстами. Другие типы (CNN, RNN, GAN, Diffusion) применяются в изображениях, аудио, видео, науке и бизнесе.

Так что, когда речь идет о собирательном термине, описывающем GPT, DeepSeek, Gemini, точнее будет говорить «большие языковые модели».

Основные типы AI-моделей

|

Семейство моделей |

Примеры |

Основная задача |

Архитектура |

Тип данных |

Относится к ML |

|

LLM (large language models) |

GPT-5, Claude, DeepSeek, ЯндексGPT, LLaMA |

Генерация и обработка текста, ответы на вопросы |

Transformer (нейросеть) |

Текст |

Да |

|

CNN (convolutional neural networks) |

AlexNet, ResNet, EfficientNet |

Анализ изображений и видео |

Свёрточная нейросеть |

Изображения, видео |

Да |

|

RNN (recurrent neural networks) |

LSTM, GRU |

Обработка последовательностей (текст, аудио, временные ряды) |

Рекуррентная нейросеть |

Текст, звук, временные ряды |

Да |

|

GAN (generative adversarial networks) |

StyleGAN, BigGAN |

Генерация изображений, deepfake |

Генеративно-состязательная нейросеть |

Изображения, видео |

Да |

|

Diffusion models |

Stable Diffusion, Imagen, Runway |

Генерация изображений, видео, аудио |

Диффузионная нейросеть (U-Net) |

Изображения, видео, звук |

Да |

|

Vision Transformers (ViT) |

ViT, CLIP |

Классификация и мультимодальные задачи (текст + картинка) |

Transformer (нейросеть) |

Изображения, текст |

Да |

|

Reinforcement Learning (RL) |

AlphaGo, DQN, PPO |

Обучение стратегическому поведению |

Policy network (нейросеть) + среда |

Игры, робототехника, оптимизация |

Да |

|

Байесовские модели |

Naive Bayes, Bayesian Networks |

Классификация, вероятностное моделирование |

Вероятностные графовые модели |

Табличные, текст |

Да |

|

Символьный AI (GOFAI) |

Prolog-системы, экспертные системы |

Логические выводы, экспертные знания |

Символы и правила |

Знания, базы данных |

Нет |

|

Фаззи-логика (Fuzzy logic) |

Системы управления (авто, техника) |

Работа с неточными данными |

Нечёткие множества |

Сенсорные данные, управление |

Нет |

|

Поисковые и оптимизационные алгоритмы |

A*, Genetic algorithm |

Оптимизация, планирование |

Графовые алгоритмы, эволюция |

Комбинаторные данные |

Частично |

LLM-модели

Правильно ли называть все LLM-модели чатом GPT?

Нет, не правильно. Не все подгузники – это Pampers, и не все генеративные модели – это GPT.

GPT (generative pre-trained transformer) — это продвинутая нейросетевая модель для генерации текста, разработанная компанией OpenAI.

Что означают термины в аббревиатуре GPT?

- Generative (генеративный). Модель умеет создавать новый текст, а не просто анализировать уже существующий. Главное отличие от «обычных» ML-моделей: они только классифицируют или предсказывают, а GPT генерирует содержимое.

- Pre-trained (предобученный). Модель сначала обучается на огромных массивах текста (книги, статьи, сайты), чтобы усвоить язык, грамматику, логику и знания. Потом её дополнительно обучают (fine-tune) на специализированных задачах или с помощью обратной связи от людей (RLHF — reinforcement learning with human feedback). Это позволяет быстро адаптировать GPT к конкретным целям без «обучения с нуля».

- Transformer (трансформер). Это архитектура нейросети, на которой построена модель. Главное новшество: механизм внимания (attention), который позволяет модели понимать контекст слова в предложении, учитывая связь с другими словами. Благодаря трансформерам LLM могут обрабатывать длинные тексты и сохранять смысл, а не «теряться» после пары предложений, как старые модели.

Итого: GPT = генеративная модель на архитектуре трансформеров, предварительно обученная на огромном массиве данных, а потом донастроенная под задачи.

Но есть много других LLM-моделей кроме GPT.

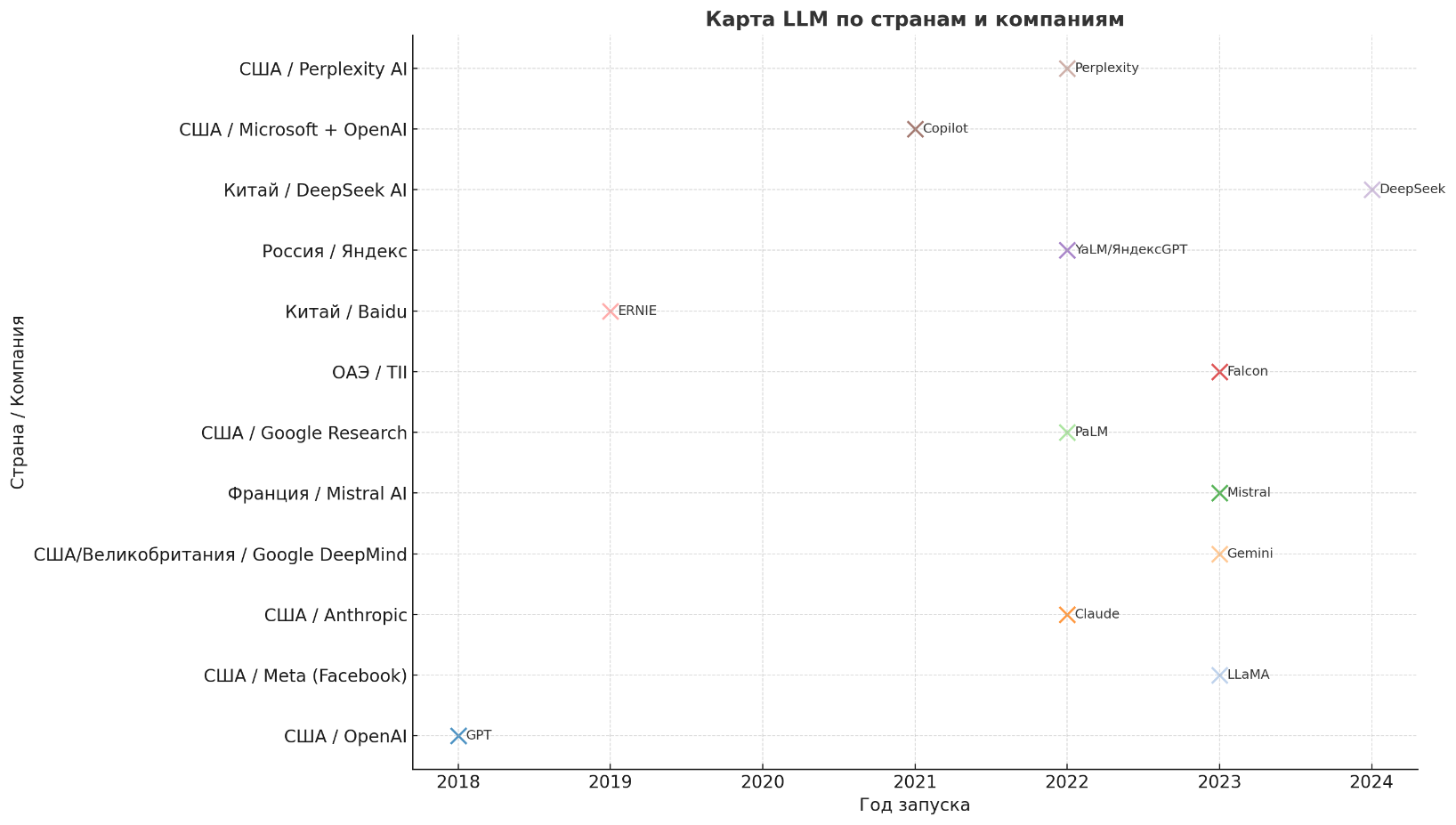

Таблица LLM-моделей (август 2025 года)

|

Название модели |

Расшифровка |

Компания/автор |

Страна |

Год запуска |

Тип данных |

Архитектура |

|

GPT |

Generative Pre-trained Transformer |

OpenAI |

США |

2018 (GPT-1) |

Текст |

Transformers (LLM) |

|

LLaMA |

Large Language Model Meta AI |

Meta (Facebook) |

США |

2023 (LLaMA-1) |

Текст |

Transformers (LLM) |

|

Claude |

В честь Клода Шеннона, «отца» информационной теории |

Anthropic |

США |

2022 |

Текст |

Transformers (LLM) |

|

Gemini |

Google DeepMind Gemini (аллюзия на созвездие Близнецов) |

Google DeepMind |

США/Великобритания |

2023 (Gemini 1) |

Мультимодальная (текст, изображения, код) |

Transformers + Multimodal extensions |

|

Mistral |

Названа в честь сильного холодного ветра в Средиземноморье |

Mistral AI |

Франция |

2023 |

Текст |

Transformers (LLM) |

|

PaLM |

Pathways Language Model |

Google Research |

США |

2022 |

Текст |

Transformers (Pathways) |

|

Falcon |

Названа в честь быстрого и сильного сокола |

Technology Innovation Institute |

ОАЭ |

2023 |

Текст |

Transformers (LLM) |

|

ERNIE |

Enhanced Representation through Knowledge Integration (Baidu) |

Baidu |

Китай |

2019 (ERNIE 2.0) |

Текст |

Transformers (LLM) |

|

YaLM/ЯндексGPT |

Языковая модель от Яндекса |

Яндекс |

Россия |

2022 |

Текст |

Transformers (LLM) |

|

DeepSeek |

Китайская LLM от DeepSeek AI (название: «глубокий поиск») |

DeepSeek AI |

Китай |

2024 |

Текст |

Transformers (LLM) |

|

Copilot |

Название отражает назначение: помощник-разработчик |

Microsoft + OpenAI |

США |

2021 |

Код (в основе — текст) |

Transformers (LLM), интегрированный в IDE |

|

Perplexity |

Название от математического термина «perplexity» (меры неопределённости модели) |

Perplexity AI |

США |

2022 |

Текст + поиск (AI Search Engine) |

Transformers (LLM) + retrieval (RAG) |

Карта LLM-моделей по годам создания, странам и компаниям

Примеры правильного употребления терминов генеративного AI

- AI / Искусственный интеллект. «Мы используем AI-решения, чтобы автоматизировать аналитику и ускорить обработку данных рекламных кампаний».

- ML / Машинное обучение. «На основе ML-алгоритмов мы строим прогнозы поведения клиентов и рекомендуем корректировать рекламные бюджеты по регионам».

- Нейросети. «Нейросети помогают нам анализировать изображения товаров и автоматически подбирать релевантные креативы для рекламы».

- LLM (Большие языковые модели). «Благодаря LLM, таким как GPT-5 или Claude, мы можем генерировать текстовые описания и FAQ, которые поисковые системы и AI-ассистенты подхватывают быстрее».

- Generative AI / Генеративный ИИ. «Мы применяем Generative AI для подготовки вариаций баннеров и текстов — это ускоряет A/B-тесты и снижает стоимость производства контента».

- GEO (generative engine optimization). «Сейчас важно не только SEO, но и GEO — оптимизация под генеративные поисковые системы (ChatGPT, Perplexity, Gemini). Мы поможем сделать так, чтобы ваш бренд появлялся в их ответах».

- RLHF (обучение с подкреплением с обратной связью человека). «Современные модели, такие как ChatGPT, обучены методом RLHF. Это значит, что они выдают ответы, максимально похожие на “человеческие” и полезные для пользователей».

- Perplexity. «Мы отслеживаем, как ваш бренд упоминается в Perplexity — это новый AI-поисковик, который всё чаще используют в бизнес-аналитике и при поиске поставщиков».

- Copilot. «Copilot от Microsoft ускоряет работу с кодом и документами. Мы используем его для повышения эффективности внутренних процессов при разработке типовых продуктов».